Die Regressionsanalyse ist ein unverzichtbares Werkzeug in der Datenanalyse. Sie ermöglicht es uns Zusammenhänge zwischen Variablen zu verstehen und Vorhersagen zu treffen. In diesem Artikel werden wir verschiedene Methoden der Regressionsanalyse im Detail betrachten und ihre praktischen Anwendungen erläutern.

Wir werden untersuchen wie einfache lineare Regressionen bis hin zu komplexeren Modellen wie multipler Regression funktionieren. Auch die Herausforderungen und typischen Fehlerquellen in der Anwendung dieser Methoden kommen nicht zu kurz. Wussten Sie dass eine präzise Regressionsanalyse entscheidend für fundierte Entscheidungen in Unternehmen sein kann? Lassen Sie uns gemeinsam eintauchen in die faszinierende Welt der Regressionsanalysen und herausfinden wie sie unseren Alltag beeinflussen können.

Regressionsanalyse: Grundlagen und Konzepte

Die Regressionsanalyse ist ein statistisches Verfahren, das es uns ermöglicht, Beziehungen zwischen Variablen zu untersuchen. Im Kern zielt die Regressionsanalyse darauf ab, eine Vorhersage- oder Erklärungsstruktur für eine abhängige Variable in Bezug auf eine oder mehrere unabhängige Variablen zu schaffen. Diese Methode findet nicht nur Anwendung in der Wirtschaft und den Sozialwissenschaften, sondern auch in Naturwissenschaften und Ingenieurwesen.

Grundlegende Konzepte der Regressionsanalyse

Um die Regressionsanalyse effektiv anzuwenden, müssen wir einige grundlegende Konzepte verstehen:

- Abhängige Variable: Dies ist die Variable, die wir vorhersagen oder erklären möchten.

- Unabhängige Variablen: Diese sind die Faktoren, von denen wir annehmen, dass sie einen Einfluss auf die abhängige Variable haben.

- Modellformulierung: Die Auswahl des richtigen Modells ist entscheidend für den Erfolg. Häufig verwendete Modelle sind lineare Regression, multiple Regression und logistische Regression.

Lineare Regression

Die einfachste Form der Regressionsanalyse ist die lineare Regression. Hierbei wird angenommen, dass zwischen der abhängigen und der unabhängigen Variablen eine lineare Beziehung besteht. Mathematisch lässt sich dieses Verhältnis durch folgende Gleichung darstellen:

[ y = a + b cdot x ]

Hierbei steht (y) für die abhängige Variable, (x) für die unabhängige Variable und (a) sowie (b) für Parameter des Modells.

Multiple Regression

In vielen Fällen möchten wir jedoch mehr als eine unabhängige Variable berücksichtigen. Die multiple Regression erweitert das Konzept der einfachen linearen Regression um zusätzliche Faktoren:

[ y = a + b_1 cdot x_1 + b_2 cdot x_2 + … + b_n cdot x_n ]

Diese Erweiterung erlaubt uns komplexere Zusammenhänge zu modellieren und genauere Vorhersagen zu treffen.

Praktische Anwendungen

Die Anwendungsfelder der Regressionsanalyse sind vielfältig:

- In der Marktforschung zur Analyse von Kundenverhalten.

- In der Gesundheitsforschung zur Untersuchung von Risikofaktoren.

- In den Wirtschaftswissenschaften zur Prognose von finanziellen Trends.

Durch diese Vielfalt an Anwendungsmöglichkeiten hat sich die Regressionsanalyse als unverzichtbares Werkzeug etabliert.

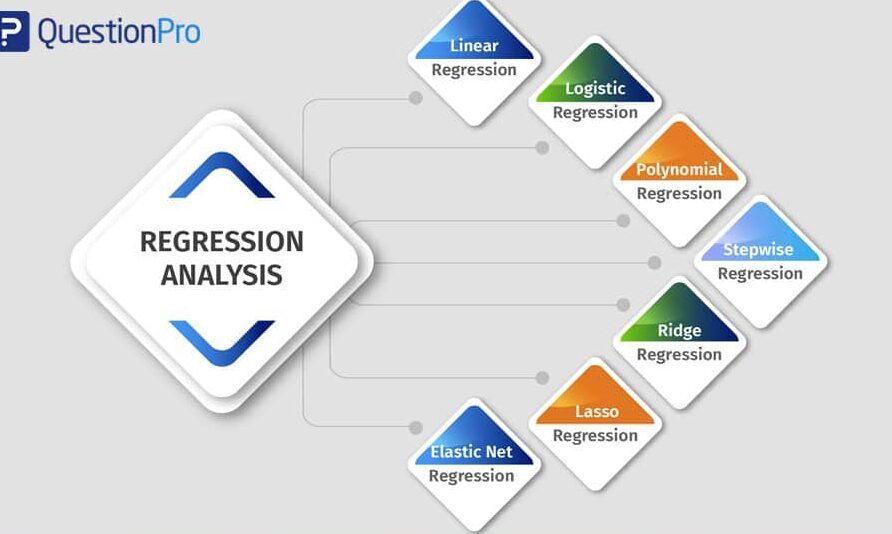

Arten der Regressionsmethoden im Überblick

In der Regressionsanalyse gibt es eine Vielzahl von Methoden, die jeweils unterschiedliche Ansätze zur Modellierung der Beziehungen zwischen Variablen bieten. Diese Methoden sind entscheidend, um den spezifischen Anforderungen einer Analyse gerecht zu werden und präzise Vorhersagen zu ermöglichen. Im Folgenden stellen wir einige der gängigsten Regressionsmethoden vor und erläutern ihre charakteristischen Merkmale.

Lineare Regression

Die lineare Regression ist die grundlegendste Form der Regressionsanalyse. Sie beschränkt sich auf die Annahme, dass eine lineare Beziehung zwischen der abhängigen und einer oder mehreren unabhängigen Variablen besteht. Diese Methode eignet sich besonders gut für einfache Zusammenhänge, in denen ein klarer Trend erkennbar ist. Die Schätzung der Parameter erfolgt häufig über das kleinste Quadrate-Verfahren.

Multiple Regression

Wenn wir mit mehreren unabhängigen Variablen arbeiten möchten, greift man zur multiplen Regression. Sie erweitert das Konzept der linearen Regression um zusätzliche Einflussfaktoren:

| Modellformel | Bedeutung |

|---|---|

| [ y = a + b_1 cdot x_1 + b_2 cdot x_2 + … + b_n cdot x_n ] | a: Achsenabschnitt; b_i: Koeffizienten für jede unabhängige Variable; x_i: Werte der unabhängigen Variablen |

Diese Methode ermöglicht es uns, komplexere Zusammenhänge abzubilden und genauere Vorhersagen zu treffen.

Logistische Regression

Die logistische Regression wird verwendet, wenn die abhängige Variable kategorisch ist, zum Beispiel bei binären Entscheidungen wie Ja/Nein oder Erfolg/Misserfolg. Diese Methode modelliert die Wahrscheinlichkeit eines bestimmten Ergebnisses basierend auf den Eingangsvariablen:

| Modellformel | Bedeutung |

|---|---|

| [ P(y=1) = frac{1}{1 + e^{-(a + b_1 cdot x_1 + … + b_n cdot x_n)}}] | P(y=1): Wahrscheinlichkeit des Eintretens des Ereignisses (z.B. Erfolg); a: Achsenabschnitt; b_i: Koeffizienten für jede unabhängige Variable; x_i: Werte der unabhängigen Variablen |

Dadurch können wir nicht nur Vorhersagen treffen, sondern auch Wahrscheinlichkeiten quantifizieren.

Kleinste-Quadrate-Regressionsanalyse vs. Robustheitsanalysen

Zudem unterscheiden wir zwischen verschiedenen Techniken innerhalb dieser Hauptmethoden. Während die klassische kleinste-Quadrate-Methode anfällig für Ausreißer ist, bieten robustere Analysen Alternativen an, die diese Probleme minimieren können. Robuste Regressionsverfahren gewährleisten somit stabilere Ergebnisse in Anwesenheit von Datenanomalien.

Letztendlich hängt die Wahl der passenden Regessionsmethode stark vom spezifischen Anwendungsfall sowie den Daten ab. In jedem Fall bleibt es unser Ziel als Analysten und Forscher sicherzustellen, dass unsere Modelle sowohl aussagekräftig als auch anwendbar sind.

Anwendungsbeispiele der Regressionsanalyse in der Praxis

In der Praxis finden wir eine Vielzahl von Anwendungsbeispielen für die Regressionsanalyse, die in verschiedenen Bereichen von entscheidender Bedeutung sind. Diese Methoden ermöglichen es, komplexe Datenmuster zu verstehen und fundierte Entscheidungen zu treffen. Im Folgenden beleuchten wir einige konkrete Beispiele aus unterschiedlichen Branchen, um die Vielseitigkeit der Regressionsanalyse aufzuzeigen.

Wirtschaft und Finanzwesen

Im Wirtschafts- und Finanzsektor wird die Regressionsanalyse häufig zur Vorhersage von Aktienkursen oder zur Bewertung von Risiken eingesetzt. Unternehmen nutzen multiple Regressionen, um den Einfluss verschiedener Faktoren wie Marktbedingungen, Zinssätze und Unternehmensgewinne auf den Aktienkurs zu analysieren. Ein Beispiel ist die Analyse des Zusammenhangs zwischen Werbeausgaben und Umsatzsteigerungen:

| Faktor | Einfluss auf den Umsatz (%) |

|---|---|

| Werbung im Fernsehen | 25% |

| Online-Marketing-Kampagnen | 40% |

| Sonderangebote | 15% |

Diese Daten zeigen uns klar, welche Marketingstrategien am effektivsten sind.

Gesundheitswesen

Im Gesundheitswesen kann die Regressionsanalyse dazu verwendet werden, Patientendaten zu modellieren und Behandlungsergebnisse vorherzusagen. Beispielsweise könnte eine logistische Regression eingesetzt werden, um das Risiko eines bestimmten Gesundheitsereignisses (z.B. Herzinfarkt) basierend auf Risikofaktoren wie Alter, Geschlecht und Lebensstil zu bewerten:

- Hoher Blutdruck

- Diabetes

- Rauchen

Durch diese Methode können Ärzte präventive Maßnahmen gezielt empfehlen.

Bildungssysteme

Im Bildungsbereich hilft uns die Regressionsanalyse dabei, den Einfluss verschiedener Faktoren auf den akademischen Erfolg der Schüler zu untersuchen. Dabei könnten Einflussgrößen wie sozioökonomischer Status, Anwesenheit oder Lernmethoden betrachtet werden:

| Einflussfaktor | Korrelation zum Notendurchschnitt (0 – 1) | |

|---|---|---|

| Anwesenheit in Klassenstunden | 0.75 | |

| Zuhause lernen (Stunden pro Woche) | 0.65 | |

| Beteiligung an Zusatzprogrammen |

0.80 |

Die Ergebnisse dieser Analysen können Schulen helfen, gezielte Förderprogramme einzuführen.

Die Anwendungsbeispiele verdeutlichen eindrucksvoll das Potenzial der Regressionsanalyse in verschiedenen Disziplinen. Durch diese vielseitigen Anwendungen können wir wertvolle Einblicke gewinnen und fundierte Entscheidungen treffen – sei es im Bereich Wirtschaft, Gesundheit oder Bildung.

Interpretation von Ergebnissen in der Regressionsforschung

Die Interpretation der Ergebnisse in der Regressionsforschung ist von entscheidender Bedeutung, um die gewonnenen Erkenntnisse korrekt zu verstehen und anzuwenden. Bei der Analyse von Daten müssen wir nicht nur auf die Zahlen schauen, sondern auch auf den Kontext und die Beziehung zwischen den Variablen. Die statistischen Parameter, wie zum Beispiel Koeffizienten oder p-Werte, geben uns wertvolle Hinweise darauf, welche Faktoren signifikant sind und in welchem Maße sie Einfluss auf das untersuchte Phänomen haben.

Koeffizienten und deren Bedeutung

Die Koeffizienten einer Regressionsanalyse zeigen uns an, wie stark eine unabhängige Variable die abhängige Variable beeinflusst. Ein positiver Koeffizient deutet darauf hin, dass mit steigendem Wert der unabhängigen Variable auch der Wert der abhängigen Variable steigt. Umgekehrt gilt für negative Koeffizienten: Hier sinkt die abhängige Variable mit steigendem Wert der unabhängigen Variablen.

| Unabhängige Variable | Koeffizient | Bedeutung |

|---|---|---|

| Werbeausgaben | 0.5 | Erhöhung des Umsatzes |

| Preis | -0.8 | Rückgang des Umsatzes bei Preiserhöhung |

Solche Tabellen helfen uns dabei, einen schnellen Überblick über die Auswirkungen bestimmter Faktoren zu gewinnen.

Signifikanztests

Neben den Koeffizienten spielen auch Signifikanztests eine zentrale Rolle bei der Interpretation unserer Ergebnisse. Der p-Wert gibt an, ob ein beobachteter Effekt statistisch signifikant ist oder zufällig auftreten könnte. In vielen wissenschaftlichen Studien wird ein Schwellenwert von 0.05 verwendet: Liegt der p-Wert darunter, so können wir davon ausgehen, dass es sich um einen echten Effekt handelt.

- p < 0.01: Sehr hoch signifikant

- p < 0.05: Signifikant

- p > 0.05: Nicht signifikant

Diese Unterscheidung hilft uns dabei zu entscheiden, welche Variablen wirklich wichtig sind und weitere Untersuchungen verdienen.

Konfidenzintervalle

Zusätzlich zur Analyse von Koeffizienten und Signifikanzen sollten wir auch Konfidenzintervalle betrachten, da sie Informationen über die Unsicherheit unserer Schätzungen liefern. Ein Konfidenzintervall zeigt den Bereich an möglichen Werten für einen Parameter an; je enger dieses Intervall ist, desto präziser ist unsere Schätzung:

- Ein Konfidenzintervall von [1.2; 1.8] für einen positiven Koeffizienten bedeutet beispielsweise hohe Zuverlässigkeit.

Indem wir diese verschiedenen Aspekte zusammenbringen – Koeffizienteninterpretation, Signifikanztests und Konfidenzintervalle – erhalten wir ein umfassendes Bild darüber, wie gut unser Regressionsmodell funktioniert und welche praktischen Implikationen sich daraus ableiten lassen.

Durch diese strukturierte Herangehensweise an die Ergebnisse können wir fundierte Entscheidungen treffen basierend auf einer soliden Grundlage der Regressionsanalyse und damit ihre Anwendung in unterschiedlichen Bereichen weiter optimieren.

Herausforderungen und Limitationen bei der Anwendung von Regressionsmodellen

Die Anwendung von Regressionsmodellen bringt zahlreiche Herausforderungen und Limitationen mit sich, die wir bei der Durchführung einer Regressionsanalyse beachten müssen. Eine zentrale Schwierigkeit liegt in der Auswahl geeigneter Variablen. Es besteht oft das Risiko, dass wir relevante Faktoren übersehen oder irrelevante Variablen einbeziehen, was zu verzerrten Ergebnissen führen kann. Darüber hinaus ist es wichtig, die Multikollinearität zu berücksichtigen. Wenn unabhängige Variablen stark miteinander korrelieren, können die Schätzungen der Koeffizienten instabil werden und das Modell weniger zuverlässig machen.

Eine weitere Herausforderung stellt die Annahme der Linearity dar. Viele Regressionsmodelle gehen davon aus, dass die Beziehungen zwischen den Variablen linear sind. In der Realität sind viele Phänomene jedoch nicht-linear und erfordern möglicherweise komplexere Modelle oder Transformationen der Daten.

Überanpassung (Overfitting)

Ein häufiges Problem bei der Anwendung von Regressionsmodellen ist die Überanpassung (Overfitting). Dabei wird ein Modell so stark an die Trainingsdaten angepasst, dass es auch deren Rauschen erlernt und somit schlechter auf neuen Daten performt. Um dieses Risiko zu minimieren, sollten wir Techniken wie Kreuzvalidierung verwenden oder Modelle mit einer geringeren Komplexität bevorzugen.

Annahmen des Modells

Die Validität unserer Ergebnisse hängt zudem von verschiedenen Annahmen ab, wie zum Beispiel:

- Normalverteilung der Residuen

- Homoskedastizität (konstante Varianz)

- Unabhängigkeit der Fehlerterm

Wenn diese Bedingungen nicht erfüllt sind, kann dies unsere Schlussfolgerungen erheblich beeinflussen und sogar falsche Entscheidungen nach sich ziehen.

Zusätzlich zur Berücksichtigung dieser statistischen Anforderungen müssen wir auch externe Einflüsse im Auge behalten. Äußere Faktoren wie Änderungen in Marktbedingungen oder unvorhersehbare Ereignisse können unsere Modelle untergraben und deren Vorhersagekraft einschränken.

Insgesamt sollten wir uns bewusst sein, dass trotz ihrer Stärke als Analysetools auch Regressionsanalysen ihre Grenzen haben. Durch eine kritische Reflexion über diese Herausforderungen können wir jedoch fundiertere Entscheidungen treffen und die Anwendung dieser Methoden optimieren.