In der heutigen Welt sind Daten allgegenwärtig und ihre Analyse ist entscheidend für fundierte Entscheidungen. Was ist Clustern und wie kann es uns helfen, Muster in unseren Datensätzen zu erkennen? Clustering-Techniken ermöglichen es uns, ähnliche Datenpunkte zu gruppieren und dadurch wertvolle Erkenntnisse zu gewinnen. Diese Methoden sind nicht nur für Unternehmen von Bedeutung sondern auch für Wissenschaftler und Analysten.

In diesem Artikel werden wir die Grundlagen des Clusterns untersuchen und erklären wie diese Technik in der Datenanalyse funktioniert. Wir zeigen auf warum Clustern ein unverzichtbares Werkzeug zur Identifizierung von Trends und Anomalien ist. Sind Sie bereit mehr über die Vorteile des Clusterns zu erfahren? Lassen Sie uns gemeinsam in die faszinierende Welt der Datenanalyse eintauchen!

Was ist Clustern in der Datenanalyse?

Clustern ist ein zentraler Prozess in der Datenanalyse, der es uns ermöglicht, große Datenmengen zu segmentieren und Muster zu identifizieren. Bei dieser Methode gruppieren wir ähnliche Datensätze, sodass wir die zugrunde liegenden Strukturen besser verstehen können. Durch das Clustern schaffen wir eine vereinfachte Darstellung komplexer Informationen, was die Analyse und Interpretation erheblich erleichtert.

Es gibt verschiedene Gründe, warum Clustering in der Datenanalyse von Bedeutung ist:

- Datenreduktion: Durch das Gruppieren ähnlicher Elemente reduzieren wir die Komplexität.

- Mustererkennung: Wir entdecken verborgene Beziehungen zwischen den Datenpunkten.

- Segmentierung: Marktforschung oder Kundenanalysen profitieren enorm von einer zielgerichteten Segmentierung.

Um die Funktionsweise des Clusterings besser zu verstehen, schauen wir uns einige häufige Ansätze an.

Die verschiedenen Methoden des Clusterings

Es gibt eine Vielzahl von Methoden, die wir beim Clustern in der Datenanalyse anwenden können. Diese Techniken unterscheiden sich hinsichtlich ihrer Ansätze und Zielsetzungen, was es uns ermöglicht, je nach Datensatz und Fragestellung die passende Methode auszuwählen. Im Folgenden stellen wir einige der gängigsten Clustering-Methoden vor.

K-Means-Clustering

Eine der bekanntesten Methoden ist das K-Means-Clustering. Bei diesem Ansatz definieren wir zunächst die Anzahl der Cluster (K), die wir bilden möchten. Anschließend wird jeder Datenpunkt dem Cluster zugeordnet, dessen Mittelpunkt (Zentrum) am nächsten liegt. Der Algorithmus wiederholt diesen Prozess, bis sich die Mittelpunkte nicht mehr signifikant ändern.

Vorteile:

- Einfach zu implementieren

- Effizient bei großen Datensätzen

Nachteile:

- Sensibel gegenüber Ausreißern

- Die Wahl von K kann herausfordernd sein

Hierarchisches Clustering

Eine weitere Methode ist das hierarchische Clustering, das entweder agglomerativ oder divisiv sein kann. Beim agglomerativen Ansatz beginnen wir mit jedem Datenpunkt als eigenständigem Cluster und fügen schrittweise ähnliche Cluster zusammen. Der divisive Ansatz hingegen beginnt mit einem einzigen Cluster und teilt ihn iterativ auf.

Vorteile:

- Keine vorherige Festlegung der Anzahl an Clustern notwendig

- Schafft eine Baumstruktur (Dendrogramm) zur Visualisierung der Beziehungen

Nachteile:

- Höherer rechnerischer Aufwand im Vergleich zu K-Means

- Weniger effektiv bei sehr großen Datensätzen

DBSCAN (Density-Based Spatial Clustering of Applications with Noise)

DBSCAN ist eine dichtebasierte Methode, die gut geeignet ist für Datensätze mit unterschiedlich geformten Gruppen und Rauschen. Sie identifiziert Cluster basierend auf den Dichten von Punkten in einem bestimmten Bereich und kann somit auch Ausreißer erkennen.

Vorteile:

- Fähigkeit zur Erkennung beliebig geformter Cluster

- Robust gegenüber Rauschen

Nachteile:

- Die Auswahl geeigneter Parameter kann komplex sein

- Schwierigkeiten bei variierenden Dichten innerhalb eines Datensatzes

Diese verschiedenen Methoden des Clusterings bieten uns wertvolle Werkzeuge zur Analyse unserer Daten. Indem wir sie gezielt einsetzen, können wir tiefere Einsichten gewinnen und bedeutungsvolle Muster aufdecken, was unsere Entscheidungen in der Datenanalyse erheblich unterstützen kann.

Anwendungsbeispiele für Clustering-Techniken

Im Bereich der Datenanalyse finden Clustering-Techniken in einer Vielzahl von Anwendungen Verwendung. Diese Methoden ermöglichen es uns, Muster und Strukturen innerhalb von Datensätzen zu identifizieren, die auf den ersten Blick möglicherweise nicht erkennbar sind. Nachfolgend erläutern wir einige spezifische Anwendungsbeispiele, die verdeutlichen, wie effektiv das Clustern sein kann.

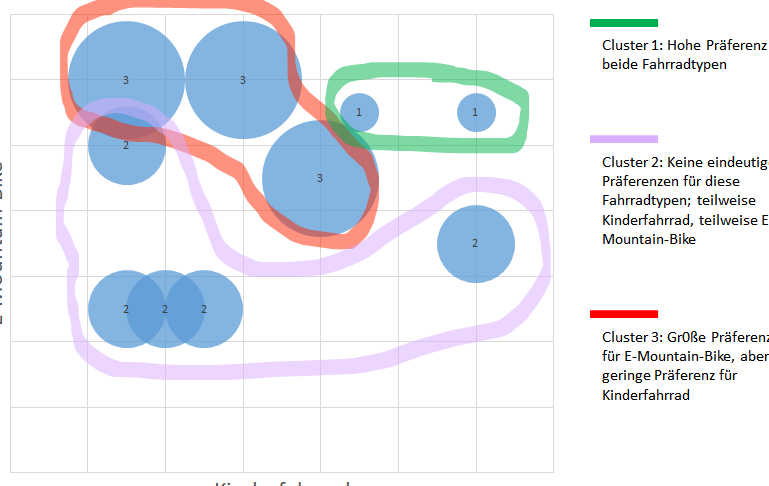

Kundensegmentierung

Eine der häufigsten Anwendungen des Clusterings ist die Kundensegmentierung im Marketing. Unternehmen nutzen diese Technik, um ihre Kunden in verschiedene Gruppen einzuteilen, basierend auf Verhaltensdaten oder demografischen Merkmalen. Dadurch können gezielte Marketingstrategien entwickelt werden, die besser auf die Bedürfnisse und Wünsche verschiedener Kundengruppen abgestimmt sind.

Vorteile dieser Anwendung:

- Erhöhung der Kundenzufriedenheit durch personalisierte Angebote

- Effizientere Ressourcennutzung im Marketing

Bildverarbeitung

In der Bildverarbeitung wird Clustering oft verwendet, um Objekte oder Regionen innerhalb eines Bildes zu identifizieren. Technologien wie das K-Means-Clustering kommen hier zum Einsatz, um Pixel mit ähnlichen Farben zu gruppieren und dadurch bestimmte Bereiche hervorzuheben oder zu segmentieren.

Beispielhafte Vorteile:

- Verbesserung der automatischen Bilderkennung

- Unterstützung bei medizinischen Bildanalysen zur Identifizierung von Anomalien

Soziale Netzwerkanalyse

Ein weiteres spannendes Anwendungsfeld ist die soziale Netzwerkanalyse, wo Clustering-Techniken dazu dienen können, Gemeinschaften innerhalb großer Netzwerke zu erkennen. Durch das Gruppieren von Nutzern oder Interaktionen können interessante Einblicke in soziale Dynamiken gewonnen werden.

Wichtige Aspekte:

- Aufdeckung versteckter Beziehungen zwischen Nutzern

- Optimierung von Empfehlungsalgorithmen

Diese Beispiele zeigen eindrucksvoll, wie vielseitig und leistungsfähig Clustering-Techniken sind. Sie ermöglichen es uns nicht nur, komplexe Datenmengen besser zu verstehen, sondern auch strategische Entscheidungen in verschiedenen Bereichen fundierter zu treffen.

Die Rolle von Algorithmen im Clustering-Prozess

Im Clustering-Prozess spielen Algorithmen eine entscheidende Rolle, da sie die Methoden zur Gruppierung von Daten definieren und steuern. Diese Algorithmen sind dafür verantwortlich, die Datenpunkte basierend auf ihrer Ähnlichkeit oder Distanz in verschiedene Cluster zu unterteilen. Je nach den spezifischen Anforderungen des Anwendungsfalls können unterschiedlichste Algorithmen eingesetzt werden, die jeweils eigene Vor- und Nachteile mit sich bringen.

Ein weit verbreiteter Algorithmus ist der K-Means-Algorithmus, der darauf abzielt, Datenpunkte in K-Gruppen zu teilen. Dieser Ansatz erfordert eine vorherige Festlegung der Anzahl K, was sowohl eine Stärke als auch eine Herausforderung darstellen kann. Die Schritte dieses Algorithmus umfassen:

- Initialisierung: Auswahl von K zufälligen Punkten als Anfangszentren.

- Zuweisung: Zuordnung jedes Datenpunkts zum nächstgelegenen Zentrum.

- Aktualisierung: Berechnung neuer Zentren durch Mittelwertbildung aller Punkte innerhalb eines Clusters.

- Wiederholung: Wiederholung der Schritte 2 und 3, bis keine signifikanten Änderungen mehr auftreten.

Neben K-Means existieren auch andere Algorithmen wie DBSCAN (Density-Based Spatial Clustering of Applications with Noise), der besonders nützlich ist, wenn es um die Identifizierung von beliebig geformten Clustern geht und robust gegenüber Ausreißern ist.

Herausforderungen bei der Wahl des richtigen Algorithmus

Die Auswahl des geeigneten Clustering-Algorithmus hängt stark vom Datensatz ab sowie von den Zielen unserer Analyse. Hierbei sind einige Herausforderungen zu beachten:

- Skalierbarkeit: Nicht alle Algorithmen skalieren gut mit großen Datensätzen.

- Parameterempfindlichkeit: Viele Algorithmen erfordern das Einstellen spezifischer Parameter, deren optimale Werte oft nicht klar sind.

- Interpretierbarkeit: Die Ergebnisse müssen für Anwender verständlich sein; komplexe Modelle können schwer nachvollziehbar sein.

Durch das Verständnis dieser Aspekte können wir gezielt entscheiden, welcher Algorithmus am besten geeignet ist für unseren speziellen Anwendungsfall im Bereich des Clusterings und somit effektiver Muster in unseren Daten erkennen.

Vorteile und Herausforderungen beim Clustern

Beim Clustern von Daten stehen wir vor einer Vielzahl von Vorteilen und Herausforderungen, die uns sowohl Möglichkeiten als auch Hürden bieten. Einer der Hauptvorteile des Clusterings ist die Fähigkeit, Muster in großen Datensätzen zu erkennen. Durch das Gruppieren ähnlicher Datenpunkte können wir wertvolle Einblicke gewinnen, die zur Entscheidungsfindung beitragen. Darüber hinaus ermöglicht uns das Clustering, komplexe Informationen zu vereinfachen und visuell darzustellen, was insbesondere in der Geschäftsanalyse von Nutzen ist.

Allerdings müssen wir auch einige Herausforderungen im Blick behalten. Eine zentrale Schwierigkeit besteht darin, den richtigen Algorithmus auszuwählen, da nicht alle Verfahren für jede Art von Datensatz geeignet sind. Zudem kann es herausfordernd sein, die optimale Anzahl an Clustern festzulegen; eine falsche Wahl kann zu irreführenden Ergebnissen führen.

Vorteile des Clusterings

- Erkennung von Mustern: Das Clustering hilft dabei, versteckte Strukturen innerhalb großer Datenmengen aufzudecken.

- Datenkompression: Es vereinfacht große Datensätze durch deren Reduzierung auf wesentliche Gruppen.

- Segmentierung: Wir können Zielgruppen besser definieren und personalisierte Ansätze entwickeln.

Herausforderungen beim Clustern

- Wahl des Algorithmus: Die Vielzahl an verfügbaren Algorithmen erfordert ein tiefes Verständnis ihrer Eigenschaften und Anwendungsbereiche.

- Skalierbarkeit: Einige Algorithmen sind möglicherweise nicht gut geeignet für sehr große oder hochdimensionale Datensätze.

- Interpretation der Ergebnisse: Die gewonnenen Cluster müssen verständlich kommuniziert werden; dies kann bei komplexen Ergebnissen schwierig sein.

Insgesamt bietet das Clustern also eine leistungsstarke Methode zur Analyse unserer Daten, fordert uns jedoch gleichzeitig dazu auf, sorgfältig mit den gewählten Techniken umzugehen und ihre Limitationen zu berücksichtigen. Nur durch eine fundierte Herangehensweise können wir sicherstellen, dass unsere Analysen präzise und aussagekräftig bleiben.